こんにちは、マナです。

今回は、生成AIの中心的な技術である大規模言語モデル(LLM: Large Language Model)について、基本からやさしく解説していきます。

ChatGPT、Claude、Geminiなど、多くの生成AIはこのLLMをベースに動いています。

JDLA Generative AI Test(生成AIリテラシー試験)では、この構造や学習方法に関する理解がよく問われるので、しっかりおさえておきましょう!

🔠 そもそも「言語モデル」とは?

言語モデルとは、文章の中で「次に来る言葉(単語や文字)」を予測するためのモデルです。

例:「私は今日、カフェでコーヒーを( )」

→「飲んだ」「注文した」など、もっともらしい語を予測します。

このような予測を高い精度で行うために、大量の文章データで学習されたものが大規模言語モデル(LLM)です。

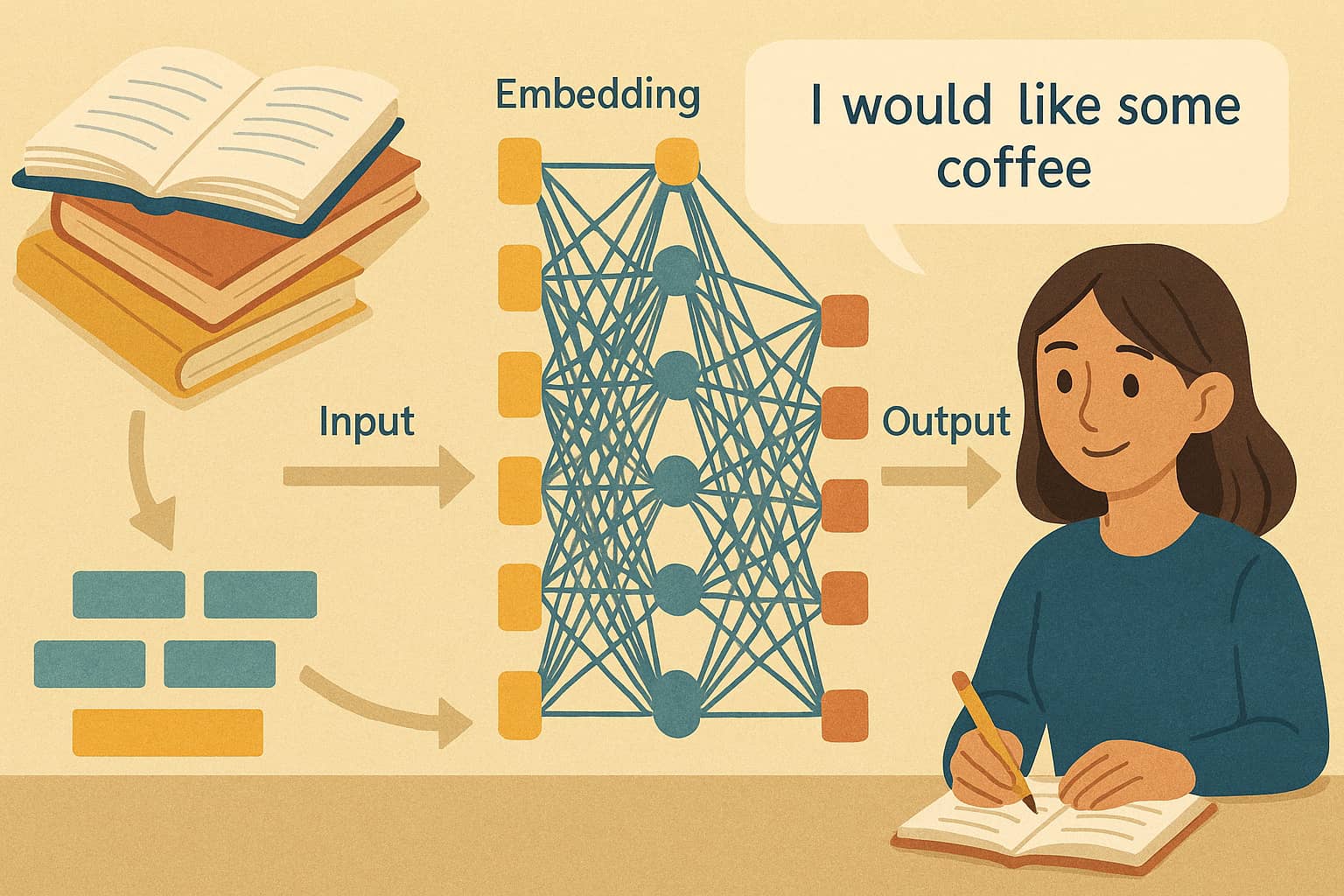

🧠 LLMの基本構造

LLMの多くは、Transformer(トランスフォーマー)というアーキテクチャをベースにしています。

主な構造の特徴:

- トークン化: テキストを「単語のかけら」に分割

- 埋め込み(Embedding): トークンをベクトル(数値)に変換

- 自己注意(Self-Attention)機構: 文章内の重要な関係性を捉える

→ 長文でも文脈を理解できる理由! - 多層構造(Layer): 数十〜数百層のネットワークで情報を抽象化

🔍 各構造の具体例

トークン化: たとえば「私はChatGPTを使っています」という文をトークン化すると、[“私”, “は”, “Chat”, “G”, “PT”, “を”, “使っ”, “て”, “います”] のように細かく分解されます。これによってAIは単語の構造を細かく理解します。

埋め込み(Embedding): トークンをコンピューターが扱える数値に変換します。例えば「コーヒー」と「紅茶」はベクトル空間でも近く配置され、意味的に近いと認識されます。

「コーヒー」→ [0.81, 0.23, -0.10, …]

「紅茶」→ [0.78, 0.25, -0.12, …]

「自動車」→ [0.05, -0.91, 0.88, …]

自己注意機構(Self-Attention): 「太郎は花子にプレゼントを渡した。彼女はとても喜んだ。」のような文の場合、「彼女」が指しているのは「花子」ですが、AIは自己注意機構によって「彼女」と「花子」の関連性が強いことを判断できます。

多層構造: 情報を段階的に処理する深層ネットワーク。単語理解から文章全体の意味まで、層を重ねて抽象度を上げていく設計です。

例えるなら、「人間の思考プロセスのステップ」のようなもので:

1.単語レベルの意味理解

2.文全体の構造を把握

3.複数文にわたる文脈を整理

4.出力として自然な文章を生成

…というふうに、層が深くなるほど抽象度の高い情報を処理できるようになります。

これらの仕組みにより、LLMは文脈や意味をとらえた自然な応答が可能になります。

📚 LLMの学習方法のステップ

① 事前学習(Pre-training)

- インターネット上の大量のテキストで言語パターンを学習

- あらゆる話題に対応できる汎用的な知識を習得

- 「空欄補完ゲーム」のような形式で学習される

② ファインチューニング(Fine-tuning)

- 特定のタスク向けにモデルを最適化

- 対話、要約、翻訳などへの応用性を高める段階

③ RLHF(人間のフィードバックによる強化学習)

- ユーザーとの対話をもとに「人間らしい応答」へ調整

- 丁寧さ・安全性・共感性を高める

✍️ 試験対策ポイント(よく出るキーワード)

| 用語 | 説明 |

|---|---|

| トークン | テキストを構成する最小単位(単語の一部など) |

| Transformer | 自己注意機構を使ったニューラルネットワーク構造 |

| Self-Attention | 文章内の重要な箇所を見極める仕組み |

| Embedding | トークンをベクトルに変換する処理 |

| 事前学習 | 一般的な知識や文章構造を学ぶ段階 |

| ファインチューニング | 特定タスク向けの調整学習 |

| RLHF | 人間の評価を反映し、出力を改善する手法 |

✅ 試験対策まとめ

Q:大規模言語モデル(LLM)の特徴を説明せよ。

→ テキストの次に来る単語を予測する確率モデルであり、

トークン化・埋め込み・自己注意・多層構造などによって、

高精度な自然言語処理を実現している。

Q:LLMの学習ステップには何があるか?

→ ① 事前学習で言語パターンを学び、

② ファインチューニングで特定タスクに適応、

③ RLHFで人間らしさと安全性を向上させる。

📘 おわりに

大規模言語モデル(LLM)は、生成AIの中でも中核的な技術です。

その構造や学習の流れを理解することで、「なぜこの応答が返ってくるのか?」を説明できるようになります。

JDLA Generative AI Testでは、仕組みを理解した上でのリテラシーが求められるので、

この記事のポイントをしっかり押さえておきましょう!

これからも一緒に、基礎からしっかり学んでいきましょう📘

Comment